出品 | 搜狐科技

作者 | 梁昌均

7月31日,在ISC.AI2024数字安全峰会上,中国工程院院士吴世忠表示,人工智能以集群式的科技创新,全面推进新一轮科技革命赋能和生活赋能,以颠覆式的应用创新全面推进新一轮大国博弈和社会变革,但也带来前所未有的安全风险和挑战。

“人们担心技术演进失控、军备竞赛失察、道德伦理失范、网络安全失守,客观上需要加强相应的安全研究,以有效的管控重大的风险和隐患。”吴世忠强调。

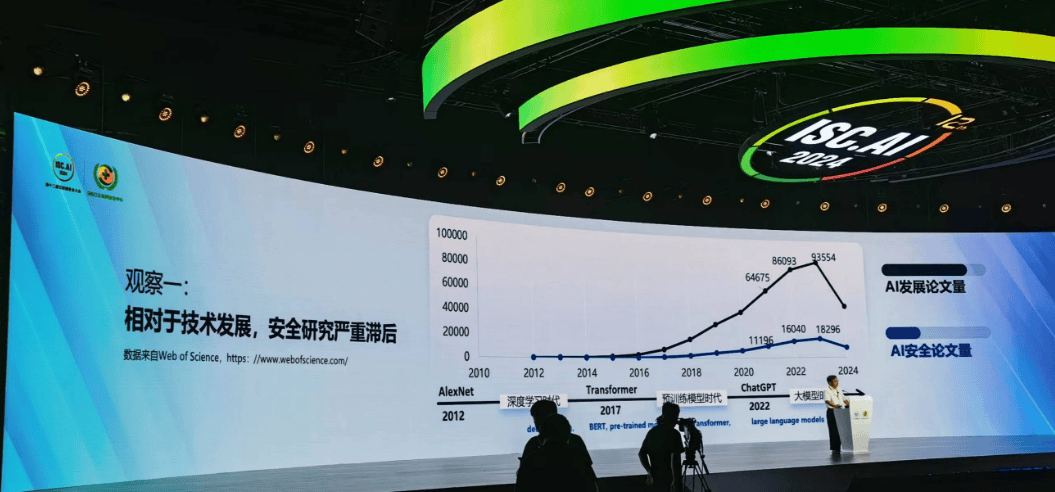

他结合自2012年以来的安全研究,从文献统计和内容分析层面分享了对AI时代网络安全研究的观察。研究显示,相对于技术创新方面的发展,安全研究严重滞后,特别是Transformer面世以来的预训练大模型时期,滞后现象尤为突出。

最近三年,大模型安全相关专业论文发布数量增长较快,通过关键词分析可以发现,近40%涉及大模型攻击,30%涉及大模型安全,25%涉及大模型防御,同时与大模型安全相关技术、专利申请和授权数量也在逐年走高。“尽管如此,与大模型研究的蓬勃发展相比,数量差距仍然很大。”

从全球对比来看,中国、美国、新加坡、德国、澳大利亚发表了有关大模型安全论文排名前五,中美两国形成第一梯队,中国研究最为活跃,发表论文总量甚至超过美国;中国科学院、加州大学、斯坦福大学,清华大学、微软位居前五。

但在影响力方面,美国论文的引用情况排名第一,相对而言,中国论文整体影响力偏弱,质量还有待提高,但清华大学、中国科学院、港科大、中科大等高校的影响力已经跻身世界前列,发展潜力最大。

从企业主体来看,OpenAI、谷歌、Meta,以及百度、阿里、华为等国内外企业纷纷在安全研究上进行布局和投资。“这说明国内外的主流厂商逐渐认识到安全研究的重要性,这已经逐渐成为业界的共识。”吴世忠说。

在研究内容层面,吴世忠提到,这些论文研究范围广,覆盖众多热点。在理论研究方面,主要关注鲁棒性、可解释性和公平性;在技术研究方面,主要包括对抗样本、监测与防御,证明与验证;在伦理研究方面,包括法律法规、伦理准则,以及国际合作。

“在应用研究方面,大模型在自动驾驶、医疗健康、金融科技等领域应用最为成熟,但要在确保风险可控的情况下,积极促进人工智能技术成果的转化和应用推广。”吴世忠表示。

在大模型安全研究方面,主要覆盖监测、防御、攻击、评测、治理等五大方面。“虽然各领域的研究尚处于初级阶段,但是作为安全研究的一部分,过部分的研究针对性和可见性都在做增强。”吴世忠表示。

他提到,鲁棒性和可靠性、可解释性和可理解、公平性和偏见、对抗性攻击和防御、隐私保护、人机交互、伦理和治理、监督与控制、测试和评估、关键基础应用等十大领域是目前大模型安全研究的十大热点。

通过分析目前安全研究现状,吴世忠表示,目前业内对AI安全的认知日渐清晰,而且人工智能的应用极大的改变了安全问题,未来AI安全将处于攻防安全、自身安全和伦理安全的交叉点。

不过,AI安全研究路阻且长。他认为,AI安全研究面对四难:大模型的可解释性和透明性、伦理和道德的复杂性和多样性、安全保障技术的复杂性和多样性,以及对象复杂性和工具局限性等。

吴世忠认为,这也意味着安全行业大有可为。“人工智能赋能百业千行,自然会给安全行业注入强大的发展动力。”

“虽然目前AI安全研究涉及面广,内容复杂,目前还没有形成广泛认可的学术分类体系。”吴世忠就此建议,AI安全研究重点要更加紧扣AI进化中的新型安全风险,研究成果要能够更好的支撑社会应用,推动发展治理政策的制定,研究路径要更多采用多学科、跨学科的研究方法。